الأداة الأحدث من "أوبن إيه أي" حساسة جداً ومثيرة للجدل لدرجة أن الشركة احجمت عن طرحها حتى الآن. تسمى الأداة "فويس إنجن" (Voice Engine) أو "محرّك الصوت" وهي عبارة عن نظام قادر على "توليد صوت يبدو طبيعياً ويشبه إلى حدّ كبير صوت المتحدث الأصلي" اعتماداً على 15 ثانية فقط من صوته.

صحيح أن هذه التقنية ليست جديدةً، إذ سبق لشركات ناشئة مثل "إيلفن لابز" (Eleven Labs) و"هاي جين" (HeyGen) أن طرحتا أدوات قادرة على استنساخ الأصوات انطلاقاً من عينات صوتية قصيرة، إلا أن "أوبن إيه أي" أثبتت أنها قادرة على تقديم منتجات أفضل من الموجودة حالياً. مع ذلك، كان الأجدى بـ"أوبن إيه أي" ألا تخوض هذا المجال. فالمشكلة ليست في التقنية، بل في إصرار "أوبن إيه أي" على جعل الذكاء الاصطناعي في متناول الجميع.

قالت الشركة إنها ستتخذ قرارها حيال طرح أداة "فويس إنجن" على الملأ بعد إجراء اختبارات ضيقة النطاق وتقييم نتائج "المحادثات" استناداً إلى ردة الفعل المجتمعية.

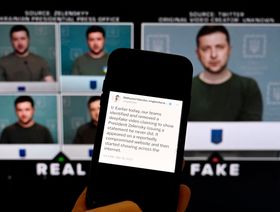

لا شك أن استنساخ الأصوات يترافق مع مخاطر بديهية. فيما تقرّ "أوبن إيه أي" بارتفاع هذه المخاطر في عام انتخابي مهم، إلا أن الشركة تهدف في الوقت نفسه إلى "فهم حدود التقنية ومشاركة كلّ ما بات ممكناً بواسطة الذكاء الاصطناعي". هنا لا بدّ من التذكير أن "أوبن إيه أي" ما عادت منظمة غير ربحية بل شركة ملزمة بالحفاظ على صدارتها لسباق الذكاء الاصطناعي الذي أطلقته.

هل حذرها حقيقي؟

إذاً ليس مفاجئاً أن تطرح "أوبن إيه أي" أداة "فويس إنجن" هذا العام. إذ كانت الشركة قد أثارت مثل هذه الضجة في فبراير 2019 حين أطلقت جزئياً برنامجها "جي بي تي-2" (GPT-2) وهو النموذج اللغوي الذي سبق "تشات جي بي تي"، وأعربت حينذاك عن قلقها من احتمال أن يستغله مرسلو الرسائل العشوائية. ولكن ما هي إلا تسعة أشهر حتى أطلقت النموذج الكامل من البرنامج، قائلة إنها "لم ترصد حتى الآن أدلة قوية تشير إلى إساءة الاستخدام". وفي الوقت نفسه تغيرت دوافعها، فقد أصبحت "أوين إيه أي" شركة تسعى للأرباح، واستحصلت على استثمار بقيمة مليار دولار من "مايكروسوفت".

هل "أوبن إيه أي" حذرة فعلاً أم أنها تستغل الحذر من قبيل الترويج لصورتها؟ تقول الشركة إن هدفها هو "الذكاء الصناعي النافع"، بالتالي كان طبيعياً أن تعرض التدوينة التي كشفت فيها عن "فويس أنجن" أمثلة عن الفوائد التي ستجلبها هذه الأداة، بما فيه منح صوت للمرضى وذوي الإعاقة العاجزين عن النطق.

برغم نبل هذه الأهداف، إلا أن تسهيل أمور الحياة لطالما استخدُم من أجل إضفاء طابع إنساني على التقنيات الجديدة. فقد سُوّق لبرمجيات تحويل النصوص إلى صوت في الأصل على أنها تهدف لمساعدة المكفوفين، ولكنها استخدمت لاحقاً من أجل تشغيل تطبيقات شائعة مثل "سيري" و"مساعد غوغل" وأنظمة الملاحة باستخدام نظام التموضع العالمي. روّج إيلون ماسك لرقاقة "نيورالينك" على أنها تساعد المصابين بالشلل، ولكن هدفه بعيد المدى هو زرع الرقاقة في أدمغة مليارات البشر.

تهديد لذوي الإعاقة

على أرض الواقع، يهدد الذكاء الاصطناعي بتصعيب حياة ذوي الإعاقة أكثر. فأدوات الذكاء الاصطناعي المستخدمة لمسح المتقدمين إلى الوظائف استثنت عن طريق الخطأ الأشخاص ذوي الإعاقة، فيما وجد تحقيق لـ"بروبوبليكا" (ProPublica) في 2023 أن عملاقة التأمين "سيغنا" (Cigna) استخدمت خوارزميات مكّنت الأطباء من رفض عدد كبير من المتقدمين بطلبات تأمين، مستهدفة بافراط ذوي الإعاقة. وقد وصفت "سيغنا" تقرير "بروبوبليكا" بأنه "متحيز وغير مكتمل".

لا توحي حواجز الحماية التي اقترحتها "أوبن إيه أي" للتعامل مع هذه التقنية بكثير من الثقة. فهي تقترح وضع "قائمة محظورات" لمنع إنتاج أصوات تبدو مشابهة جداً لأصوات "الشخصيات المعروفة". إلا أن الجوانب الخطرة لاستنساخ الأصوات ستضر أناساً عاديين أكثر من المشاهير. إذ كانت معظم المقاطع الإباحية التي انتشرت العام الماضي إثر تطور مجال الذكاء الاصطناعي التوليدي لم تستهدف مشاهير بقدر ما طالت نسوة عاديات.

كما لا يفلح دائماً التحقق من هوية المتحدث الأصلي وتوثيقها كما تعتزم "أوبن إيه أي" أن تفعل. منذ فترة وجيزة، استخُدمت أداة استنساخ الأصوات من "هاي جين" (HeyGen)، التي تتعاون "أوبن إيه أي" معها في تطوير "فويس إنجن"، لاستنساخ صوت مؤثرة أوكرانية على "يوتيوب" دون علمها أو إذنها، حسبما أبلغتني. فقد لاحظت أولغا لويك العلامة المائية لـ"هاي جين" في واحد من مئات مقاطع الفيديو التي استُخدم فيها جسمها وصوتها في تطبيق تواصل اجتماعي صيني. فيما تقول "هاي جين" عبر موقعها الإلكتروني إنها تطلب موافقة الشخص لاستخدام صوته، وجدت لويك "أنه تبين أن هذا الأمر غير فعّال".

تقنية قد لا تخدم البشرية

تجدر الإشارة إلى أن كثيراً من الأمثلة التي أعطتها "أوبن إيه أي" حول منافع "فويس إنجن"، مثل منح صوت للأشخاص العاجزين عن النطق لا يحتاج لاستنساخ الأصوات، بل يكفي أن يكون البرنامج قادراً على توليد صوت اصطناعي. فاستنساخ أصوات البشر يمهّد لأمور لا تحمد عقباها وهو مخاطرة لا داعي لها.

لا يقتصر الأمر على وضع أداة جديدة في متناول المحتالين والمتنمرين وغيرهم من متداولي المعلومات المضللة، بل سيتسبب ذلك على الأرجح بمشكلة في قطاع الترفيه وهوليوود نفسها فيما تحاول "أوبن إيه أي" التودد للمديرين التنفيذيين في هذا المجال واستعراض أداتها "سورا" المتخصصة بتوليد مقاطع الفيديو.

كما تهدّد تقنيات استنساخ الصوت مصادر رزق الممثلين، وكانت إحدى الممثلات البريطانيات قد أثبتت ذلك في الأسبوع الماضي حين شاركت رسالة إلكترونية تلقت فيها رفضاً، بعد أن استعيض عنها بـ"صوت مولّد بالذكاء الاصطناعي". الأجدى إذاً بـ"أوبن أيه أي" أن تتذكر أن ليس كلّ متاح مباح. فقد انجرفت الشركة في السباق الذي أطلقت شرارته بنفسها مع طرح "تشات جي بي تي" وهي حالياً ترزح تحت ضغوط الحفاظ على صدارتها من خلال تقديم نسخ أفضل عن الأدوات المنافسة وجذب مزيد من الناس لاستخدام أنظمة الذكاء الاصطناعي التي تنتجها. ولهذا السبب عمدت حديثاً إلى إزالة شرط تسجيل الدخول لاستخدام "تشات جي بي تي".

تصرّ "أوبن إيه أي" أنها تعمل انطلاقاً من رسالتها المنادية بإنشاء ذكاء اصطناعي يخدم البشرية، إلا أن الأذى الذي قد يجلبه استنساخ الأصوات يبدو أكبر وأوسع من منافعه. تبلي الشركة بلاءً حسناً في الحفاظ على مكانتها في السباق في مجال الأعمال، ولكن الشق المتعلق بالمنفعة العامة يزداد إبهاماً.